a16z: Amnesia untuk AI, dapat terus menerus belajar "menyelamatkan" itu

Terobosan adalah hal yang membuat model menjadi kuat ketika mereka dikerahkan dan dilatih: kompresi, abstraksi, pembelajaran。

Judul asli: Mengapa Kita Perlu Learing Berkala

Karya asli Malika Aubakirova, Matt Bornstein, a16z crypto

Bahasa asli: Teko Teduh Dalam

Di Memento Christopher Nolan, aktor utama, Leonard Shelby, hidup dalam momen yang rusak. Kerusakan otak menyebabkan dia menderita prokrasi dan kehilangan ingatan baru. Setiap beberapa menit, dunianya disetel kembali, terjebak dalam abadi "pada saat ini" — mengingat apa yang baru saja terjadi dan bertanya-tanya apa yang akan terjadi. Untuk bertahan hidup, ia telah menulis dan memfilmkan tubuhnya untuk menggantikan fungsi memori yang tidak dapat dilakukan otak。

Model bahasa yang besar di zaman abadi yang serupa. Setelah pelatihan, massa pengetahuan dibekukan dalam parameter, dan model tidak menciptakan kenangan baru dan tidak memperbarui parameter mereka dalam cahaya pengalaman baru. Untuk mengisi celah ini, kita meletakkannya pada perancah: sejarah chatting sebagai handprint jangka pendek, sistem pengambilan ulang sebagai notebook eksternal, petunjuk sistem sebagai tato. Tapi modelnya sendiri tidak pernah benar-benar menginternalisasi informasi baru ini。

SEMAKIN BANYAK PENELITI MENGANGGAP HAL INI TIDAK CUKUP. PEMBELAJARAN KONTEKS IKNIK (ICL) MEMECAHKAN MASALAH JIKA JAWABAN (ATAU FRAGMEN JAWABAN) SUDAH ADA DI BEBERAPA BAGIAN DUNIA. NAMUN ADA ALASAN YANG BAIK MENGAPA MODEL MEMBUTUHKAN CARA UNTUK MEMASUKKAN PENGETAHUAN DAN PENGALAMAN BARU SECARA LANGSUNG DALAM PARAMETER SETELAH PENYEBARAN, UNTUK MASALAH-MASALAH YANG PERLU BENAR-BENAR DITEMUKAN (MISALNYA SERTIFIKAT MATEMATIKA BARU), UNTUK SKENARIO KONFRONTASIONAL (MISALNYA PENCEGAHAN KEAMANAN), ATAU UNTUK PENGETAHUAN YANG TERLALU HALUS UNTUK DIUNGKAPKAN DALAM BAHASA。

belajar konteks hanya sementara. pembelajaran yang nyata membutuhkan kompresi. sampai kita membiarkan model untuk terus kompres, mungkin terjebak dalam momen abadi dari memory debris. sebaliknya, jika kita dapat melatih model untuk mempelajari struktur memori mereka sendiri, daripada mengandalkan alat-alat yang disesuaikan secara eksternal, kita dapat membuka dimensi skala yang sama sekali baru。

Lapangan ini disebutMempelajari dengan tekun(belajar terus) Konsep ini tidak baru (lihat makalah McCloskey dan Cohen 1989), tetapi kami menganggapnya sebagai salah satu arah penelitian yang paling penting dalam bidang AI saat ini. Eksplosif pertumbuhan kapasitas pemodelan selama dua sampai tiga tahun terakhir telah membuat kesenjangan antara model dikenal dan diketahui semakin jelas. Tujuan artikel ini adalah untuk membagikan apa yang telah kita pelajari dari para peneliti top di bidang ini, untuk membantu memperjelas jalur yang berbeda dari pembelajaran yang terus menerus dan untuk berkontribusi terhadap pengembangan topik ini dalam ekologi kewirausahaan。

Catatan: Bentuk artikel tersebut mendapat manfaat dari pertukaran intensif dengan sekelompok peneliti yang sangat baik, mahasiswa doktoral dan pengusaha yang dengan murah hati membagikan karya dan wawasan mereka di bidang pembelajaran yang berkesinambungan. Dari dasar teoritis untuk realitas rekayasa pasca-deployment pembelajaran, wawasan mereka telah membuat artikel lebih solid daripada kita telah menulis sendiri. Terima kasih atas waktu dan pikiranmu

Mari kita mulai dengan konteksnya

Wacana sebelum membela pembelajaran tingkat parameter (yaitu pembelajaran yang memperbarui bobot model), perlu diakui fakta bahwa pembelajaran konteks memang bekerja. Dan ada argumen yang kuat bahwa itu akan terus menang。

Inti dari Transformer adalah peramal token berikutnya berdasarkan kondisi urutan. Berikan urutan yang tepat, Anda mendapatkan perilaku yang luar biasa kaya, dan Anda tidak perlu menyentuh berat badan. Itulah sebabnya mengapa manajemen konteks, tips, instruksi halus-tuning dan beberapa contoh sampel begitu kuat. Enkapsulasi pintar adalah dalam parameter statis, dan kemampuan untuk menunjukkan perubahan secara dramatis saat Anda makan ke jendela。

Artikel in-depth baru-baru ini oleh Cursor pada pemrograman otonom smarts penskalaan adalah contoh yang baik: bobot model tetap, dan yang benar-benar membuat sistem berjalan adalah tata letak yang halus dari konteks — apa yang harus dimasukkan, kapan untuk meringkas, bagaimana mempertahankan konsistensi dalam beberapa jam operasi otonom。

OpenClaw adalah contoh lain yang bagus. Ini tidak meledak karena kelayakan model khusus (yang tersedia untuk semua di bagian bawah), tetapi karena mengubah konteks dan alat ke dalam kondisi kerja dengan efisiensi besar: melacak apa yang Anda lakukan, menyusun intermediat, memutuskan kapan untuk memperkenalkan kembali, dan mempertahankan memori abadi dari pekerjaan sebelumnya. OpenClaw mengangkat Æshell design" dari cerdas ke disiplin independen。

Ketika mempromosikan proyek itu pertama kali muncul, banyak peneliti skeptis tentang fakta bahwa "pengalihan saja" bisa menjadi antarmuka yang tepat. Ini terlihat seperti jack. Namun, ia adalah produk asli dari arsitektur Transformer, tidak memerlukan pelatihan kembali dan secara otomatis ditingkatkan sebagai model kemajuan. Modelnya semakin kuat, petunjuknya semakin kuat. Ísimplistik tetapi primitif" antarmuka sering menang karena terhubung langsung dengan sistem bawah, bukan dengannya. Sejauh ini, lintasan LLM persis seperti itu。

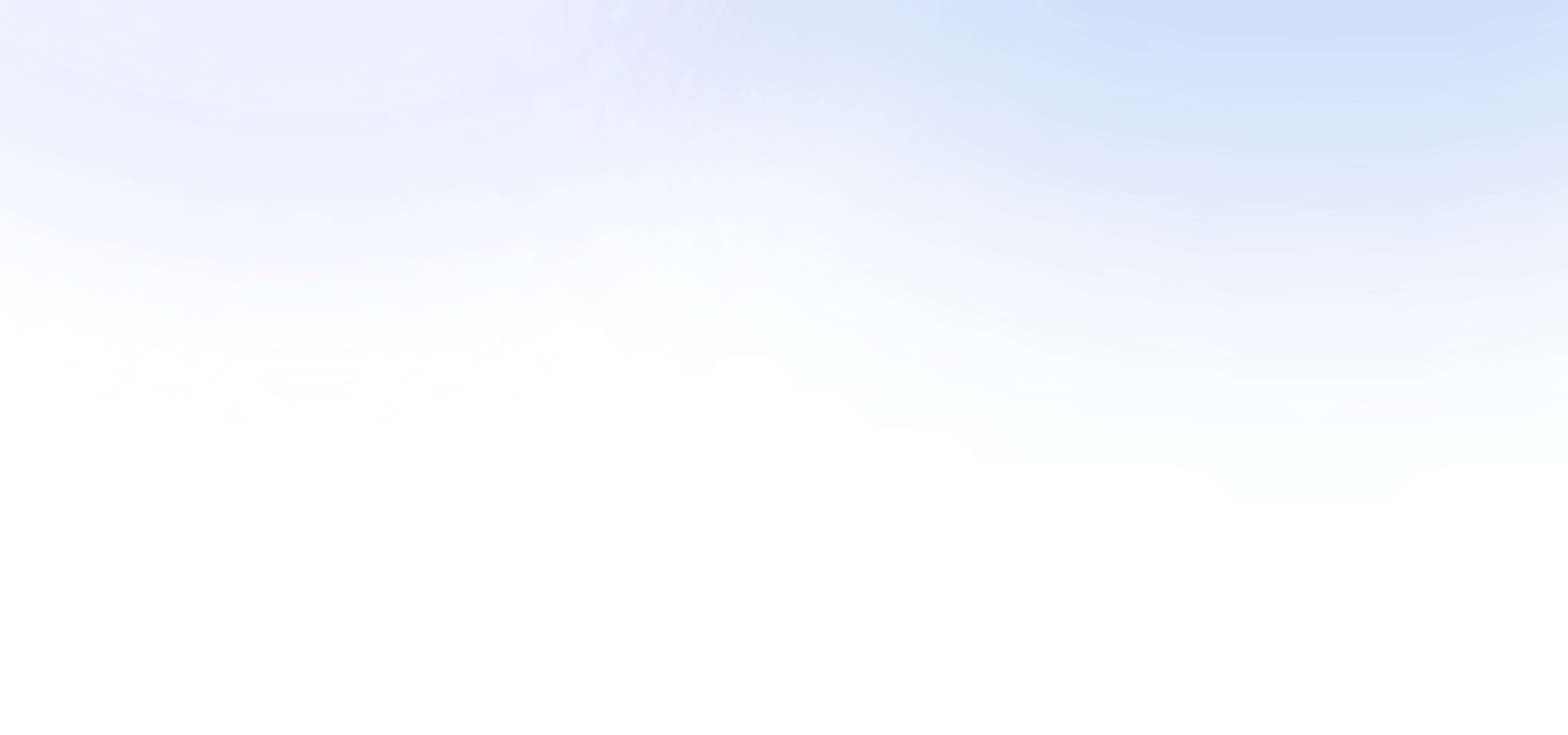

Model spasial negara bagian: Steroid versi konteks

MODEL PEMBELAJARAN KONTEKS BERADA DI BAWAH TEKANAN YANG MENINGKAT SERAYA ALIRAN KERJA ARUS UTAMA BERPINDAH DARI LLM ASLI KE SIRKULASI CERDAS. PADA MASA LALU, JENDELA KONTEKS RELATIF JARANG TERISI PENUH. INI BIASANYA TERJADI KETIKA LLM DIMINTA UNTUK MELAKUKAN BARIS PANJANG TUGAS DISKRET, DAN LAPISAN APLIKASI DAPAT MEMOTONG DAN MEMAMPATKAN SEJARAH CHAT SECARA LEBIH LANGSUNG。

Tapi untuk tubuh cerdas, misi mungkin memakan sebagian besar konteks yang selalu tersedia. Setiap langkah siklus cerdas tergantung pada konteks di mana urutan pertama berlalu. Dan mereka sering gagal 20-100 langkah kemudian, karena garis rusak: konteks diisi, konsistensi terdegradasi, dan tidak dapat terkandung。

Hasilnya, laboratorium AI utama sekarang mencurahkan sumber daya yang signifikan (yaitu operasi pelatihan skala besar) untuk mengembangkan model untuk jendela konteks super panjang. Ini adalah jalan alami, karena didasarkan pada metode yang sudah efektif (belajar dalam konteks) dan sejalan dengan industri ' s kecenderungan umum untuk beralih ke penalaran. Struktur paling umum adalah lapisan memori tetap, misalnya model spasial keadaan (SSM) dan varian perhatian linear (setelah disebut secara kolektif sebagai SSM), disisipkan di antara perhatian umum. Secara fundamental, SSM menyediakan kurva penskalaan yang lebih baik dalam suatu konteks。

Gambar: SSM dibandingkan dengan penskalaan mekanisme perhatian tradisional

Tujuannya adalah untuk membantu orang cerdas meningkatkan jumlah langkah yang konsisten hingga beberapa pesanan, dari sekitar 20 menjadi sekitar 20.000, tanpa kehilangan keterampilan dan pengetahuan yang luas yang disediakan oleh Transformer tradisional. Jika berhasil, ini adalah terobosan besar untuk kecerdasan yang berjalan lama。

Anda bahkan dapat melihat ini sebagai bentuk pembelajaran yang berkesinambungan: Meskipun pemberat model tidak diperbarui, lapisan memori eksternal diperkenalkan yang hampir tidak membutuhkan penggantian。

Jadi metode non-parametrik ini nyata dan kuat. Semua penilaian dari pembelajaran terus menerus harus dimulai dari sini. Pertanyaannya bukan apakah sistem konteks hari ini berfungsi, tapi memang begitu. Pertanyaannya adalah: Apakah kita telah melihat langit - langit, dan dapatkah pendekatan baru menuntun kita lebih jauh。

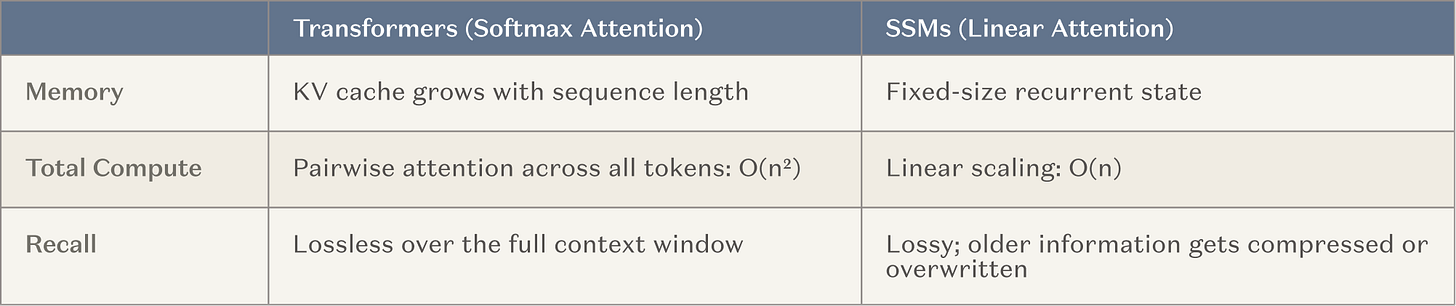

Apa yang hilang dalam konteks

AGI DAN HAL-HAL PRA-LATIH TERJADI BAHWA, DALAM ARTI, MEREKA OVERWHELM ... MANUSIA BUKAN AGI. YA, MANUSIA MEMANG MEMILIKI DASAR KETERAMPILAN, TETAPI MEREKA KURANG BANYAK PENGETAHUAN. KAMI MENGANDALKAN PEMBELAJARAN YANG TERUS MENERUS。

Jika aku membuat anak 15 tahun yang pintar, dia tidak tahu apa-apa. Seorang pelajar yang baik, ingin belajar. Anda dapat mengatakan, pergi menjadi programmer, pergi menjadi dokter. Penguraian itu sendiri melibatkan semacam pembelajaran, pengujian dan kesalahan. Ini adalah proses, bukan untuk membuang produk selesai keluar. Ilya Sutsever

Bayangkan sebuah sistem dengan ruang penyimpanan tak terbatas. Setiap lemari arsip terbesar di dunia sudah terindeks dan dapat diakses. Ini bisa menemukan apa saja. Apakah itu belajar

Tak ada. Ini tidak pernah dipaksa untuk melakukan kompresi。

Ini adalah inti dari argumen kami, yang mengutip sebuah poin yang dibuat sebelumnya oleh Ilya Sutskever: LLM pada dasarnya adalah algoritma yang dikompresi. Dalam pelatihan, mereka memampatkan Internet menjadi parameter. Mampatan itu merusak, dan kerusakan semacam itulah yang membuatnya kuat. Mampatan madya memaksa model untuk mencari struktur, generalisasi dan membangun tanda-tanda yang dapat bergerak melintasi konteks. Model dari sampel yang didukung keras dari semua pelatihan bukanlah model pola dasar. Mampatan adalah belajar sendiri。

IRONISNYA, MEKANISME YANG MEMUNGKINKAN LLM MENJADI BEGITU KUAT SELAMA PELATIHAN (MENGAGUMKAN DATA MENTAH KE DALAM MANIFESTASI YANG KOMPAK DAN DAPAT DIPINDAHKAN) PERSIS APA YANG KITA MENOLAK UNTUK MEMBIARKAN MEREKA TERUS MELANJUTKAN SETELAH PENYEBARAN. KAMI BERHENTI KOMPRESI SAAT ITU DAN MENGGANTINYA DENGAN MEMORI EKSTERNAL。

tentu saja, kebanyakan selongsong tubuh yang cerdas memampatkan konteksnya dalam beberapa cara. tapi bukankah pelajaran pahit bahwa model sendiri harus belajar memampatkan, langsung dan dalam skala besar

Yo Sun memiliki contoh perdebatan ini: matematika. Lihat Teorema Fermat. Selama bertahun-tahun, tidak ada matematikawan yang membuktikannya, bukan karena mereka kekurangan literatur yang tepat, tetapi karena solusinya sangat novel. Ada terlalu banyak jarak konseptual antara pengetahuan matematika dan jawaban akhir。

Zodische Andrew Wiles, ketika ia akhirnya mengambilnya pada 1990-an, menghabiskan tujuh tahun bekerja dalam isolasi, harus menciptakan teknologi baru untuk mencapai jawabannya. Sertifikasinya mengandalkan jembatan sukses ke dua cabang matematika yang berbeda: kurva elips dan bentuk model. Sementara Ken Ribet sebelumnya telah membuktikan bahwa koneksi ini dapat secara otomatis menyelesaikan Teorema Fermatian, tidak ada yang memiliki alat teoretis untuk benar-benar membangun jembatan sebelum Wiles. Grigori Perelman dapat melakukan hal yang sama dengan bukti dugaan Pongarai。

Masalah inti adalah:Apakah contoh - contoh ini membuktikan bahwa LLM kekurangan sesuatu, kemampuan untuk memperbarui suatu priori dan berpikir kreatif? Atau apakah ceritanya hanya membuktikan sebaliknya -- semua pengetahuan manusia adalah data yang dapat dilatih dan direstrukturisasi, Wiles dan Perelman, tetapi menunjukkan apa yang dapat LLM lakukan dalam skala yang lebih besar

Pertanyaannya adalah empiris dan jawabannya tidak pasti. Tapi kita tahu bahwa ada banyak kategori isu di mana pembelajaran di bawah akan gagal hari ini, dan pembelajaran tingkat parameter mungkin berguna. Misalnya:

Gambar: Gagal belajar konteks, kemungkinan kategori masalah untuk pembelajaran parameter

Yang lebih penting lagi, pembelajaran konteks hanya dapat berurusan dengan apa yang dapat dinyatakan dalam bahasa, sementara berat dapat mengkodekan konsep yang tidak dapat disampaikan dengan kata-kata. Beberapa model model terlalu tinggi, terlalu tidak terlihat, terlalu dalam untuk terstruktur. Sebagai contoh, dalam pemindaian medis, tekstur visual yang membedakan pseudo-tumour berbudi luhur dari tekstur visual tumor, atau fluktuasi kecil dalam audio yang mendefinisikan ritme unik dari orang yang berbicara, tidak mudah dipecah menjadi kosakata yang tepat。

Bahasa Mandarin hanya bisa mirip dengan mereka. Tidak ada petunjuk lagi yang dapat menyampaikan hal - hal ini; pengetahuan demikian hanya dapat bertahan dalam beratnya. Mereka tinggal di ruang tanda belajar, bukan kata-kata. Terlepas dari pertumbuhan jendela konteks, selalu ada beberapa pengetahuan yang tidak dapat digambarkan dalam teks dan yang hanya dapat dibawa oleh parameter。

Hal ini mungkin menjelaskan mengapa rorobot mengingat Anda" fungsi (seperti memori ChatGPT) sering membuat pengguna tidak nyaman daripada terkejut. Pengguna benar-benar ingin tidak "ingat" tetapi "kuasa." Model yang telah menginternalisasi pola perilaku Anda dapat dipindahkan ke adegan baru; model yang hanya mengingat sejarah Anda tidak bisa. Perbedaan antara "ini adalah apa yang Anda tulis terakhir kali Anda menjawab e-mail ini" (repeated verbatim) dan "saya telah memahami cara berpikir Anda cukup untuk memprediksi apa yang Anda butuhkan" adalah kesenjangan antara pencarian dan pembelajaran。

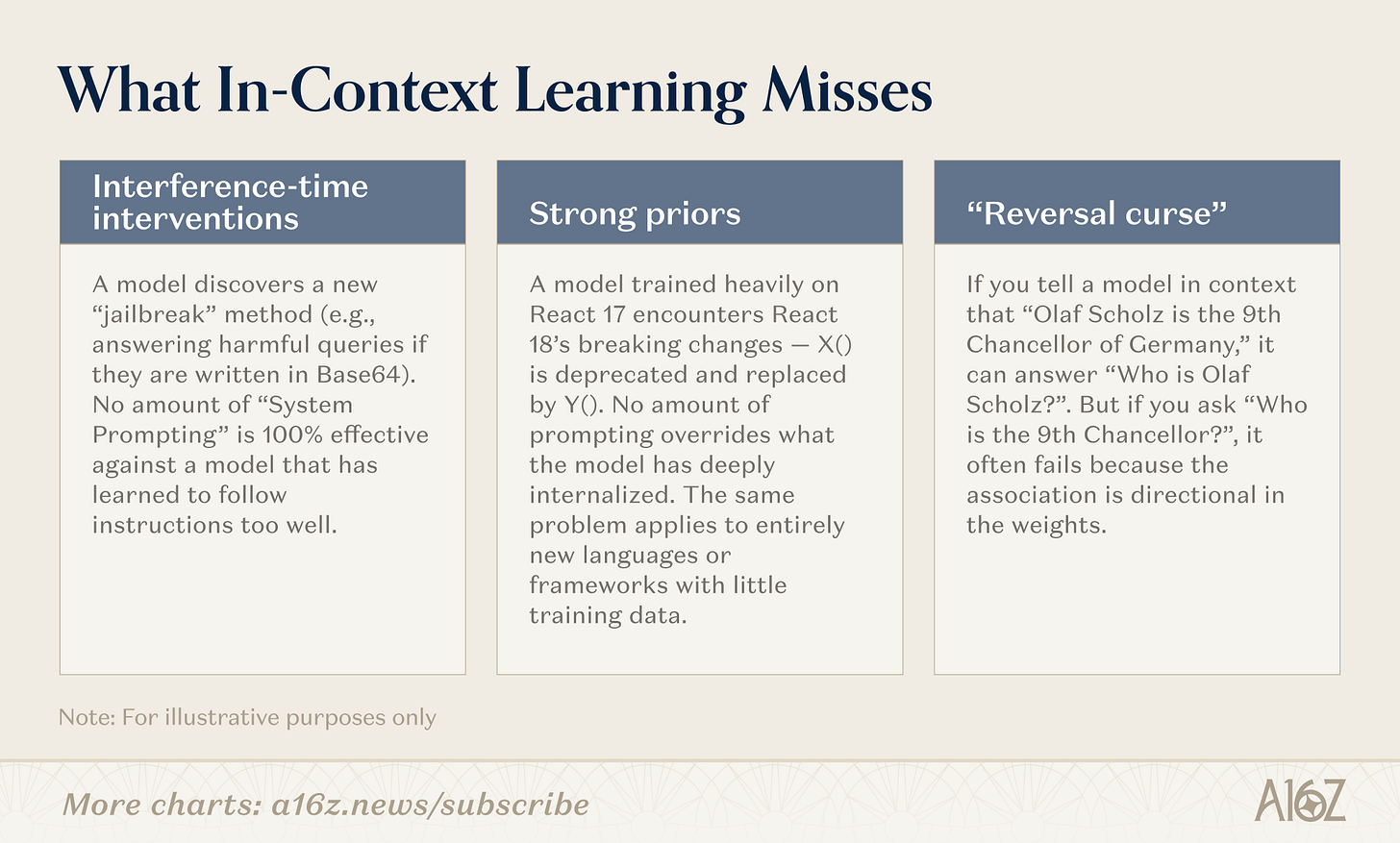

Pengantar untuk belajar terus menerus

Ada banyak cara untuk terus belajar. Garis pemisah tidak "tidak ada ingatan" tetapi:Di mana kompresi terjadiJalur-jalur ini didistribusikan di sepanjang spektrum, mulai dari tidak terkompresi (pencarian murni, pembeku berat) hingga kompresi internal penuh (pembelajaran berat, model menjadi lebih pintar), dengan area penting (module)。

Gambar: Tiga jalur untuk belajar terus - konteks, modul, berat

Konteks

Pada akhir konteks ini, tim membangun tabung pencarian yang lebih cerdas, selongsong tubuh pintar dan organisasi petunjuk. Ini adalah kategori yang paling matang: infrastruktur divalidasi dan jalur penyebaran jelas. Batasnya adalah kedalaman: panjang konteks。

Arah baru yang layak dicatat: Struktur Multi-Intelektual sebagai strategi skala untuk konteks itu sendiri. Jika model tunggal terbatas pada jendela token 128K, satu set tubuh cerdas yang terkoordinasi — masing - masing dengan konteksnya sendiri, sepotong tunggal berfokus pada masalah, dan hasil komunikasi masing - masing — dapat memperkirakan seluruh memori kerja yang tak terbatas. Setiap badan cerdas melakukan pembelajaran konteks dalam jendela sendiri; agregat sistem. Contoh-contoh terbaru dari proyek autoresearch dan peramban web Cursor adalah kasus awal. Ini adalah pendekatan non-parametrik murni (tidak mengubah berat), tetapi secara signifikan menaikkan langit-langit yang dapat dicapai sistem konteks。

Modul

Di ruang modular, tim membangun modul pengetahuan tertanam (cache KV yang dikompresi, lapisan adaptor, penyimpanan memori eksternal) untuk memprofesionalkan model generik tanpa melatih ulang. Model 8B yang model dengan modul yang sesuai dapat sesuai dengan kinerja model 109B pada tugas target, dengan okupansi memori hanya sebagai pecahan. Ketertarikan ini sejalan dengan infrastruktur Transformer yang sudah ada。

Berat

. pada akhir update berat, peneliti mencari pembelajaran tingkat parameter yang benar: memperbarui hanya lapisan memori tipis dari segmen parameter yang relevan, mengoptimalkan siklus belajar yang ditingkatkan dari model dari umpan balik, dan pelatihan dalam pengujian berat kompresi dalam konteks penalaran. ini adalah yang terdalam dan paling sulit dikerahkan, tetapi mereka memungkinkan model untuk sepenuhnya internalisasi informasi atau keterampilan baru。

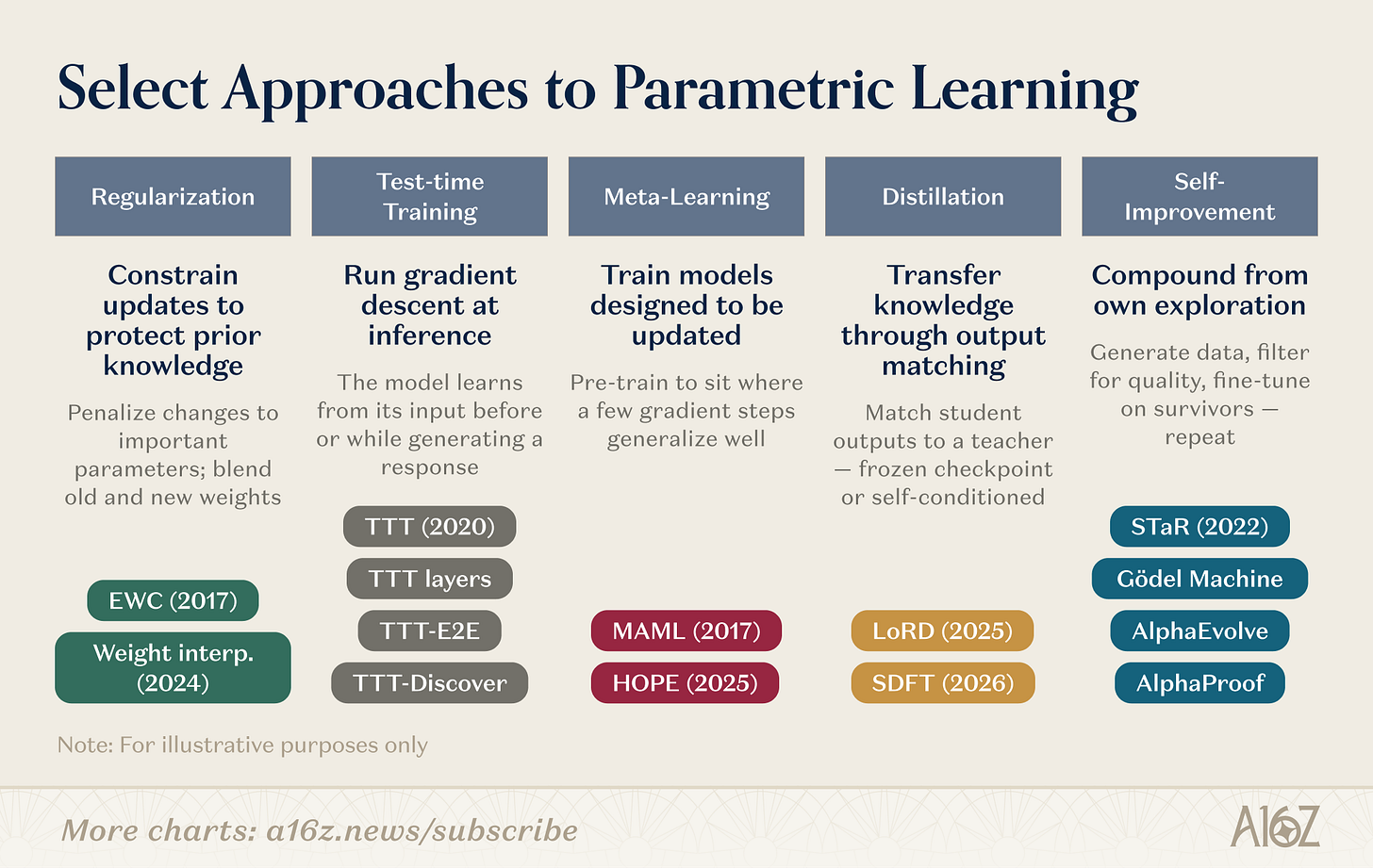

Ada banyak mekanisme spesifik untuk memperbarui parameter. Beberapa petunjuk penelitian diberi:

Gambar: Sekilas tentang arah penelitian untuk belajar pemberatan

Penelitian pemberatan itu meliputi beberapa rute paralel。Regulerisasi dan pendekatan spasial pemberatanYang tertua: EWC (Kirkpatrick et al., 2017) menghukum perubahan parameter berdasarkan pentingnya parameter ke tugas sebelumnya; interposisi berat (Kozal et al., 2024) mencampur konfigurasi berat lama dan baru di ruang parameter, tetapi keduanya rentan pada skala besar。

Pelatihan selama pengujianDiciptakan oleh Sun et al. (2020), dan kemudian dikembangkan menjadi bahasa asli arsitektur (lapisan TTT, TTT-E2E, TTT-Discover), idenya berbeda: membuat gradien turun pada data tes dan untuk memampatkan informasi baru menjadi parameter pada saat yang diperlukan。

Yuan Yuan belajarPertanyaannya adalah: Dapatkah kita melatih model untuk belajar belajar? Dari inisialisasi beberapa parameter ramah sampel MAML (Finn et al., 2017) sampai pembelajaran tertanam Behrouz et al. (Nested Learning, 2025), yang menyusun model menjadi masalah optimasi lapisan, menjalankan modul yang cepat terdaptasi dan lambat pada skala waktu yang berbeda, terinspirasi oleh konsolidasi memori biologis。

penyulinganPengetahuan tentang tugas sebelumnya dipertahankan dengan mencocokkan model siswa dengan pos pemeriksaan guru beku. LoRD (Liu et al., 2025) memungkinkan distilasi untuk beroperasi secara efisien ke titik di mana dapat dipertahankan dengan memotong model dan memutar ulang zona penyangga secara bersamaan. Pengsulingan diri sendiri (SDFT, Shenfeld et al., 2026) membalik sumber, menggunakan model ' s sendiri keluaran di bawah kondisi ahli sebagai sinyal pelatihan, melewati memori mengerikan dari halus-tuning urutan。

Rekursif perbaikan diriIa beroperasi pada jalur serupa: STAR (Zelikman et al., 2022) memandu penalaran dari rantai penalaran yang dihasilkan sendiri; AlphaEvolve (DeepMind, 2025) menemukan optimisasi algoritmik yang belum ditingkatkan selama beberapa dekade; Silver dan Sutton \"era pengalaman\" (2025) mendefinisikan pembelajaran tubuh cerdas sebagai aliran pengalaman yang terus menerus tidak pernah berhenti。

Arah penelitian ini adalah pengumpulan. Transkrip TTT-Discover memiliki pelatihan uji terpadu dan eksplorasi RL-driven. KARAH HARAPAN menghasilkan siklus belajar yang lambat dalam satu struktur. SDFT FT berubah distilasi menjadi operasi dasar untuk pengembangan diri. Batas di antara kolom adalah kabur. Generasi selanjutnya sistem pembelajaran berkelanjutan kemungkinan menggabungkan strategi: regularisasi untuk menstabilkan, mempelajari meta untuk mempercepat, dan memperbaiki diri untuk memperoleh senyawa. Banyaknya start-up yang bertaruh pada berbagai tingkat gudang teknologi ini。

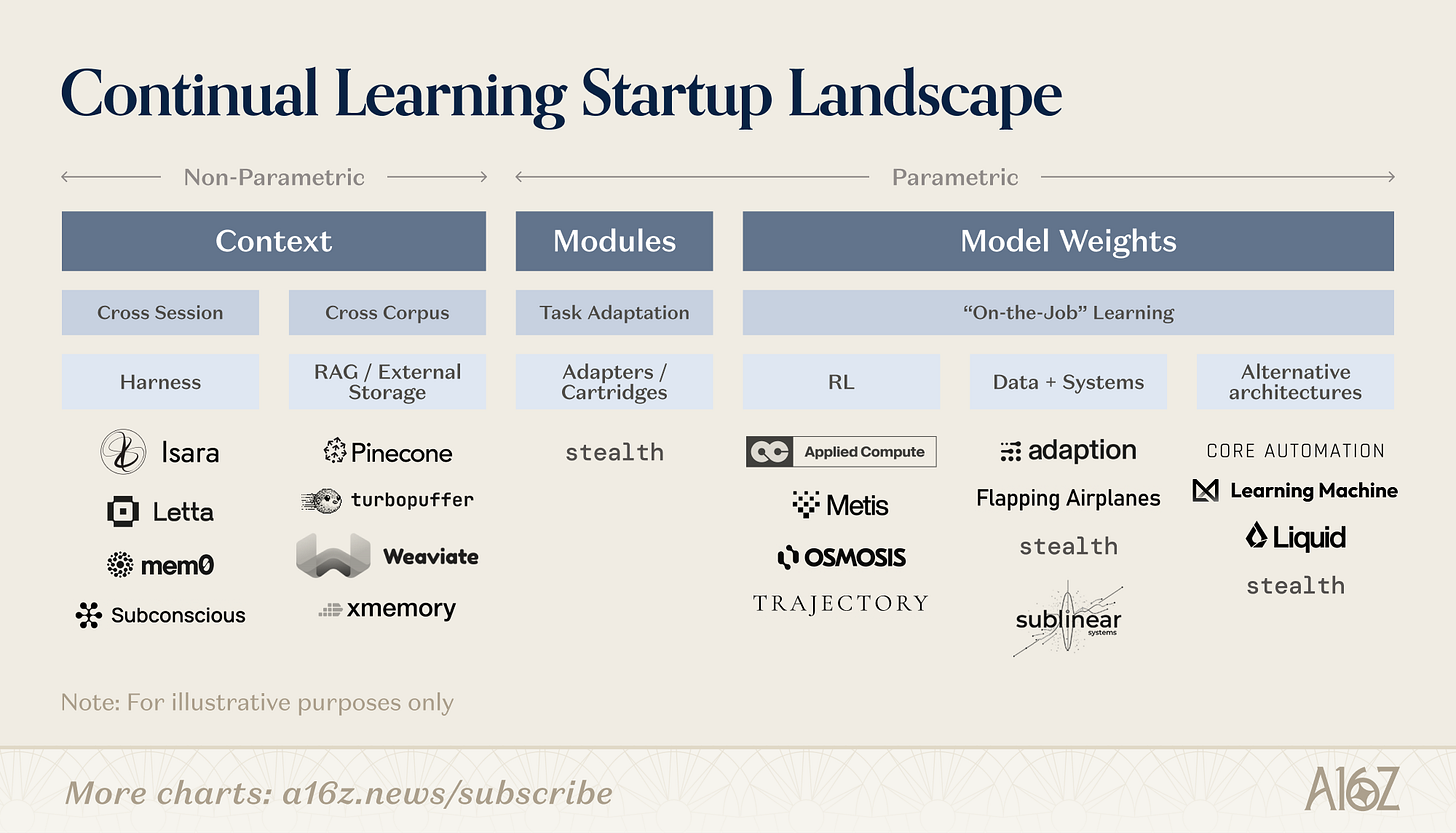

Kewirausahaan belajar terus menerus

Bagian ujung non-parameter spektrum paling dikenal. Perusahaan shell (Letta, mem0 dan Subconscious) membangun lapisan dan perancah untuk mengelola isi dari jendela konteks. Tempat penyimpanan eksternal dan infrastruktur RAG (misalnya Pinecone, xmemory) menyediakan tulang punggung pencarian. Data ada dan tantangannya adalah menempatkan irisan kanan di depan model pada waktu yang tepat. Sebagai jendela konteks berkembang, begitu pula ruang desain perusahaan-perusahaan ini, terutama di kerak luar, gelombang start-up baru muncul untuk mengelola strategi konteks yang semakin kompleks。

Parameternya lebih awal dan lebih banyak dolar. Perusahaan di sini sedang mencoba beberapa versi dari kompresi "deposisi" untuk menginternalisasi informasi baru dalam berat. Jalurnya dapat dibagi secara kasar menjadi beberapa taruhan yang berbeda, tentang model apa yang harus dipelajari setelah diterbitkan。

Anda dapat belajar tanpa menahan diri。Beberapa tim yang sedang membangun modul pengetahuan tertanam (kompresi cache KV, lapisan adapter, penyimpanan memori eksternal) untuk memprofesionalkan model generik tanpa memindahkan berat inti. Argumen umum adalah bahwa Anda dapat memperoleh kompresi yang berarti (bukan hanya pengambilan kembali), sementara menjaga keseimbangan stabilitas-plastisitas dalam batas yang dapat dikelola, karena pembelajaran dipisahkan, tidak tersebar di seluruh parameter. Model 8B disertai dengan modul yang sesuai untuk mencocokkan kinerja model yang lebih besar dalam misi target. Kelebihannya adalah portabilitas: modul dapat ditancapkan dengan struktur Transformer yang sudah ada, yang dapat ditukar secara independen atau diperbarui, dan biaya percobaan jauh lebih rendah daripada biaya pelatihan intensif。

SIKLUS UMPAN BALIK: BELAJAR DARI SINYAL。Yang lain bertaruh bahwa sinyal pembelajaran pasca-deployment yang paling berlimpah sudah ada dalam siklus penyebaran itu sendiri — sinyal imbalan untuk pembetulan pengguna, keberhasilan misi atau kegagalan, dari hasil dunia nyata. Ide intinya adalah bahwa model harus memperlakukan setiap interaksi sebagai sinyal pelatihan potensial, bukan hanya permintaan untuk penalaran. Hal ini sangat mirip dengan cara manusia maju di tempat kerja: bekerja, mendapatkan umpan balik, menginternalisasi apa yang bekerja. Tantangan teknik adalah menerjemahkan umpan balik yang tipis, berisik dan kadang-kadang berkonfrontasi ke dalam pembaharuan bobot yang stabil, tanpa kelupaan bencana. Namun, model yang benar - benar belajar dari penyebaran dapat menghasilkan nilai senyawa dengan cara yang tidak dapat dilakukan oleh sistem di bawah ini。

Fokus pada data: Belajar dari sinyal yang tepat。A terkait tetapi diferensiasi taruhan adalah bahwa botleneck tidak belajar algoritma, tetapi pelatihan data dan sistem perifer. Tim-tim ini fokus pada penyaringan, penjanaan atau sintesis data yang benar untuk mendorong pembaruan berkelanjutan: Kepramukaan ini mengemukakan bahwa model dengan sinyal pembelajaran yang berkualitas tinggi dan terstruktur dengan baik dapat ditingkatkan secara bermakna dengan gradien yang jauh lebih kecil. Ini adalah hubungan alami dengan perusahaan loop umpan balik, tetapi pertanyaan hulu ditekankan: apakah model dapat belajar adalah satu hal, apa yang harus mereka pelajari dan sejauh mana。

Arsitektur Baru: Pembelajaran kompetensi dari bawah。Pertaruhan yang paling radikal adalah bahwa arsitektur Transformer itu sendiri adalah sebuah botleneck dan bahwa pembelajaran berkesinambungan membutuhkan istilah komputasional yang berbeda secara fundamental: sebuah struktur dengan kontinuitas dinamika waktu dan mekanisme memori bawaan. Argumen di sini adalah struktural: jika Anda ingin sistem pembelajaran terus menerus, Anda harus membenamkan mekanisme pembelajaran ke dalam infrastruktur bawah。

Gambar: Awal bisnis untuk belajar terus menerus

semua laboratorium besar juga aktif dalam kategori ini. beberapa orang menjelajahi manajemen konteks dan penalaran rantai berpikir yang lebih baik, beberapa bereksperimen dengan modul memori eksternal atau tabung komputasi waktu tidur, dan beberapa perusahaan tak terlihat mengejar struktur baru. kawasan ini cukup awal untuk melihat bahwa tidak ada metode yang telah dimenangkan dan, mengingat luas kasus, seharusnya tidak ada pemenang tunggal。

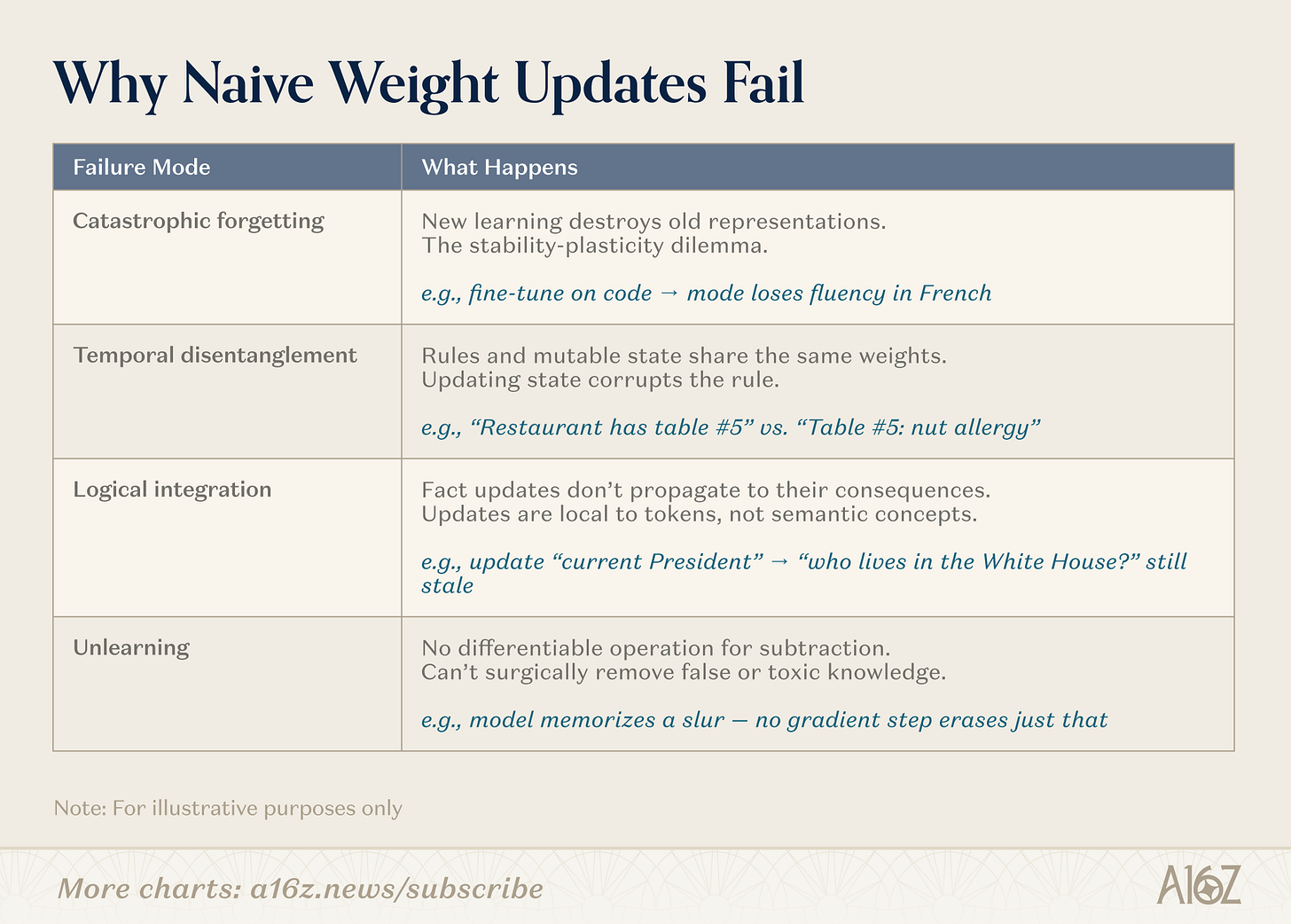

Mengapa pembaruan sederhana akan gagal

Mengemaskinikan parameter model di lingkungan produksi dapat memicu serangkaian model gagal yang saat ini belum terselesaikan dalam skala besar。

Gambar: Moda kegagalan untuk update berat sederhana

isu-isu teknik kejuruteraan telah didokumentasikan dengan baik. wawasan bencana bencana kelaparan berarti bahwa model yang cukup sensitif untuk belajar dari data baru menghancurkan manifestasi stabilitas dan plastisitas yang ada. dekomposisi waktu dekomposisi waktu berarti bahwa set berat yang sama dimampatkan oleh aturan konstan dan keadaan variabel, dan bahwa satu update akan merusak yang lain. integrasi logika logikal gagal karena pembaruan fakta tidak menyebar ke ketidakpeduliannya bahwa perubahan terbatas pada urutan token, bukan konsep semantik. tidak ada operasi de minimis, jadi tidak ada program penghapusan bedah yang tepat untuk pengetahuan palsu atau beracun。

Kategori kedua terbitan yang kurang mendapat perhatian. Kepisahan dari pelatihan dan penyebaran saat ini bukan semata-mata fasilitas teknik; itu adalah perbatasan keamanan, auditabilitas dan pemerintahan. Buka batas ini, dan banyak hal yang salah pada saat yang sama. Keselarasan keamanan mungkin tidak terduga terdegradasi: bahkan penggunaan data benign yang halus dan sempit mungkin menyebabkan gangguan yang meluas。

Pemutakhiran yang terus - menerus tanpa henti telah menciptakan suatu wajah keracunan data yang tidak menyinggung — suatu kebingungan tip yang lambat dan langgeng, tetapi hidup pada berat badan. Auditability runtuh karena model yang terus diperbarui adalah target mobile yang tidak dapat digunakan untuk kontrol versi, pengujian regresi atau autentikasi satu-off. Ketika pengguna berinteraksi ke dalam parameter, risiko privasi meningkat dan informasi sensitif adalah memanggang ke dalam bentuk, membuatnya lebih sulit untuk disaring daripada mendapatkan informasi dalam konteks。

Ini adalah masalah keterbukaan, bukan ketidakmungkinan mendasar. Mengalamatkan mereka, seperti mengatasi tantangan arsitektur inti, adalah bagian dari agenda penelitian pembelajaran yang sedang berlangsung。

Dari memori fragmen ke memori nyata

Tragedi Leonard dalam Fragmen Memori bukan berarti dia tidak bisa beroperasi — dia banyak akal dan bahkan brilian dalam skenario apapun. Tragedinya adalah bahwa ia tidak akan pernah pulih. Setiap pengalaman telah bertahan di luar — catatan yang diambil, tato, tulisan tangan orang lain. Dia bisa mencari, tapi dia tidak bisa memampatkan pengetahuan baru。

Ketika Leonard berjalan melalui labirin yang dibangun sendiri ini, garis antara kebenaran dan keyakinan mulai kabur. Penyakitnya bukan hanya menyangkal ingatannyaItu memaksanya untuk membangun kembali maksudnyaBiarkan dia menjadi detektif dan pencerita yang tak dapat diandalkan dari ceritanya sendiri。

AI HARI INI BERJALAN DI BAWAH BATASAN YANG SAMA. KAMI MEMBANGUN SISTEM PENGAMBILAN KEMBALI YANG SANGAT KUAT: JENDELA KONTEKS YANG LEBIH PANJANG, SELONGSONG YANG LEBIH CERDAS, KUMPULAN MULTI-INTELIJEN TERKOORDINASI, DAN MEREKA BEKERJA. NAMUN, PENCARIAN TIDAK BERARTI UNTUK BELAJAR. SISTEM YANG DAPAT MENGUNGKAP FAKTA APAPUN TIDAK DIPAKSA UNTUK MENCARI STRUKTUR. ITU TIDAK DIPAKSA UNTUK MENJADI GENERALISASI. BIARKAN BEGITU BANYAK PELATIHAN MENJADI BEGITU MERUSAK MENGUBAH DATA MENTAH MENJADI MEKANISME REPRESENTATIF YANG DAPAT DIPINDAHKAN - TEPAT APA YANG KITA MATIKAN PADA SAAT PENYEBARAN。

Jalur ke depan kemungkinan besar bukan terobosan tunggal, melainkan sistem berlapis. Belajar konteks bahasa Ibrani akan terus menjadi garis pertahanan pertama: itu asli, validasi dan terus ditingkatkan. Mekanisme modular coulder could ad ad ad ad ad ad ad ad ad ad ad ad ad ad ad ad add-d-d-d-d-d-d-d-d-d-d- ad-d-d-d-d- ad-d。

Namun, bagi mereka yang benar - benar sulit — pengetahuan tersembunyi yang menemukan, menyesuaikan diri, tidak dapat diungkapkan dengan kata - kata — kita mungkin perlu membiarkan model terus memampatkan pengalaman ke dalam parameter setelah pelatihan. Ini berarti kemajuan dalam arsitektur tipis, meta-learning tujuan dan pengembangan diri siklus. Ini mungkin juga memerlukan redefinisi dari apa yang model berarti: bukan satu set berat tetap, tetapi sistem evolusioner yang mencakup memorinya, algoritma diperbarui, dan kemampuan abstraknya dari pengalamannya sendiri。

Kabinet pengarsipan semakin berkembang. Tapi kabinet yang lebih besar adalah kabinet arsip. Terobosan adalah hal yang membuat model menjadi kuat ketika mereka dikerahkan dan dilatih: kompresi, abstraksi, pembelajaran. Kami berdiri di titik balik dari model kehilangan ingatan ke model dengan cahaya pengalaman. Jika tidak, kita akan terjebak dalam Debris Memori kita。

Bahasa Asli